気に入った画像を見つけたことはありませんか?AIが生成したアート作品、素晴らしいライティングの写真、独特なスタイルのイラストレーション。Midjourney、Stable Diffusion、Fluxで似たようなものを再現したいと思っても、元のプロンプトがわからないという問題があります。

画像からプロンプトへの変換は、まさにこの問題を解決します。このガイドでは、あらゆる画像をすぐに使えるAIプロンプトに変換する方法、使うべきツール、そして主要なAI画像生成モデルで最良の結果を得る方法を詳しく説明します。

クイックスタート: すぐに画像を変換したい場合は、無料AIプロンプトジェネレーターをお使いください。画像をアップロードし、モデルを選択するだけで、10秒以内にプロンプトが生成されます。アカウント登録は不要です。

画像からプロンプトへの変換とは?

画像からプロンプトへの変換とは、視覚的な画像を分析してテキスト記述(「プロンプト」)を生成するプロセスです。このプロンプトをAI画像生成ツールに入力すると、視覚的に類似した結果が生成されます。これはいわばリバースエンジニアリング — 画像から記述テキストへの変換です。

このプロセスは以下のような場面で役立ちます:

- オンラインでAI生成画像を見つけて、そのスタイルを再現したい場合

- 参考写真があり、AIに同じ雰囲気やテイストで生成してほしい場合

- 特定のビジュアルスタイルがなぜ効果的なのかを理解し、手動でより良いプロンプトを書きたい場合

- 統一感のあるビジュアルアイデンティティを構築するため、参考画像から再利用可能なプロンプトスタイルが必要な場合

画像→プロンプトツールの仕組み

最新の画像→プロンプト変換ツールは、コンピュータービジョンAI — 通常、Claude、GPT-4V、Geminiなどのマルチモーダルモデル — を使って画像を分析します。AIは複数の要素を同時に検査します:

- 被写体とコンテンツ: 画像に何が写っているか — オブジェクト、人物、シーン、動物

- 構図: 三分割法、シンメトリー、パースペクティブ、被写界深度、フレーミング

- ライティング: 自然光 vs. 人工光、ソフト vs. ハード、光の方向、色温度、影

- カラーパレット: 主要色、彩度レベル、暖色 vs. 寒色、コントラスト

- スタイルとメディア: フォトグラフィック、ペインタリー、デジタル、イラスト、シネマティック

- ムードと雰囲気: 感情的なトーン、時間帯、環境条件

- 技術的詳細: 焦点距離、カメラアングル、レンダリングスタイル

これらすべてが、特定のターゲットAIモデルに合わせたフォーマットのテキストプロンプトに統合されます。Midjourney、Stable Diffusion、Fluxはそれぞれプロンプトの構文要件が大きく異なるためです。

ステップ1:適切な画像を選ぶ

すべての画像が同じように有用なプロンプトを生成するわけではありません。最も効果的な画像の特徴を見てみましょう:

変換に適した画像

- 明確な被写体と独特なスタイル: シネマティックフォトグラフィー、ファンタジーイラスト、コンセプトアートなど、ビジュアルスタイルが意図的な画像

- AI生成画像: すでに「プロンプトに近い」品質を持っており、美的要素が意図的に作られている

- プロフェッショナル写真: スタジオ撮影、風景写真、エディトリアルフォトなど、一貫した特徴を持つ描写しやすい写真

- デジタルイラスト: アニメ、漫画、コンセプトアート — AI画像生成モデルがよく理解するスタイル

変換が難しい画像

- 被写体が混在し、明確なビジュアルテーマがないスナップショット

- テキストが多い画像(ロゴ、本の表紙)

- 非常に抽象的または非具象的な画像

- 低解像度や過度に圧縮された画像

ステップ2:ターゲットAIモデルを選択する

これは初心者のほとんどが見落としている最も重要なステップです。各AI画像生成モデルは、まったく異なるプロンプト言語を持っています。優れたMidjourneyプロンプトをStable Diffusionで使うと、期待はずれの結果になることがあり、その逆も同様です。

| 特徴 | Midjourney | Stable Diffusion | Flux | DALL·E 3 |

|---|---|---|---|---|

| プロンプトスタイル | 記述子をカンマ区切り + パラメータ | 重み付きタグ(構文:1.2) | 詳細な自然言語 | 完全な文章 |

| ネガティブプロンプト | --no flag |

専用フィールド | 非対応 | 非対応 |

| 主要パラメータ | --ar, --v, --style, --chaos |

CFG scale, steps, sampler | 最小限 | 最小限 |

| 最適な用途 | アーティスティック、シネマティック | 技術的制御、カスタムモデル | フォトリアリズム | 画像内テキスト、指示追従 |

| 例 | portrait, golden hour --ar 2:3 --v 6.1 |

(portrait:1.2), golden hour, (bokeh:0.8) |

Photograph of portrait at golden hour, Canon 85mm f/1.4 |

A portrait photograph taken during golden hour with warm, soft light |

Midjourney

Midjourneyのプロンプトは、カンマで区切られた記述フレーズにパラメータを続ける形式です。良いMidjourneyプロンプトの例:cinematic portrait of a woman in golden hour light, shallow depth of field, film grain, warm tones --ar 3:2 --v 6.1 --style raw

Stable Diffusion

Stable Diffusionは括弧とコロンを使った重み付き構文を使用します:(masterpiece:1.2), highly detailed portrait, golden hour lighting, (bokeh:0.8) — さらに別のネガティブプロンプトフィールドがあります。

Flux

Black Forest LabsのFluxは、詳細で描写的な自然言語に最も良く反応します。特別な構文を必要とせず、長く正確な記述をうまく処理します。

DALL·E 3

DALL·E 3は自然で完全な文章で最も効果的に機能します。文脈と意図を理解するため、見たいものを明確かつ直接的に記述してください。

ぜひお試しください — 画像をアップロードするだけで、数秒で最適化されたAIプロンプトが生成されます。

無料で試す →ステップ3:アップロードと分析

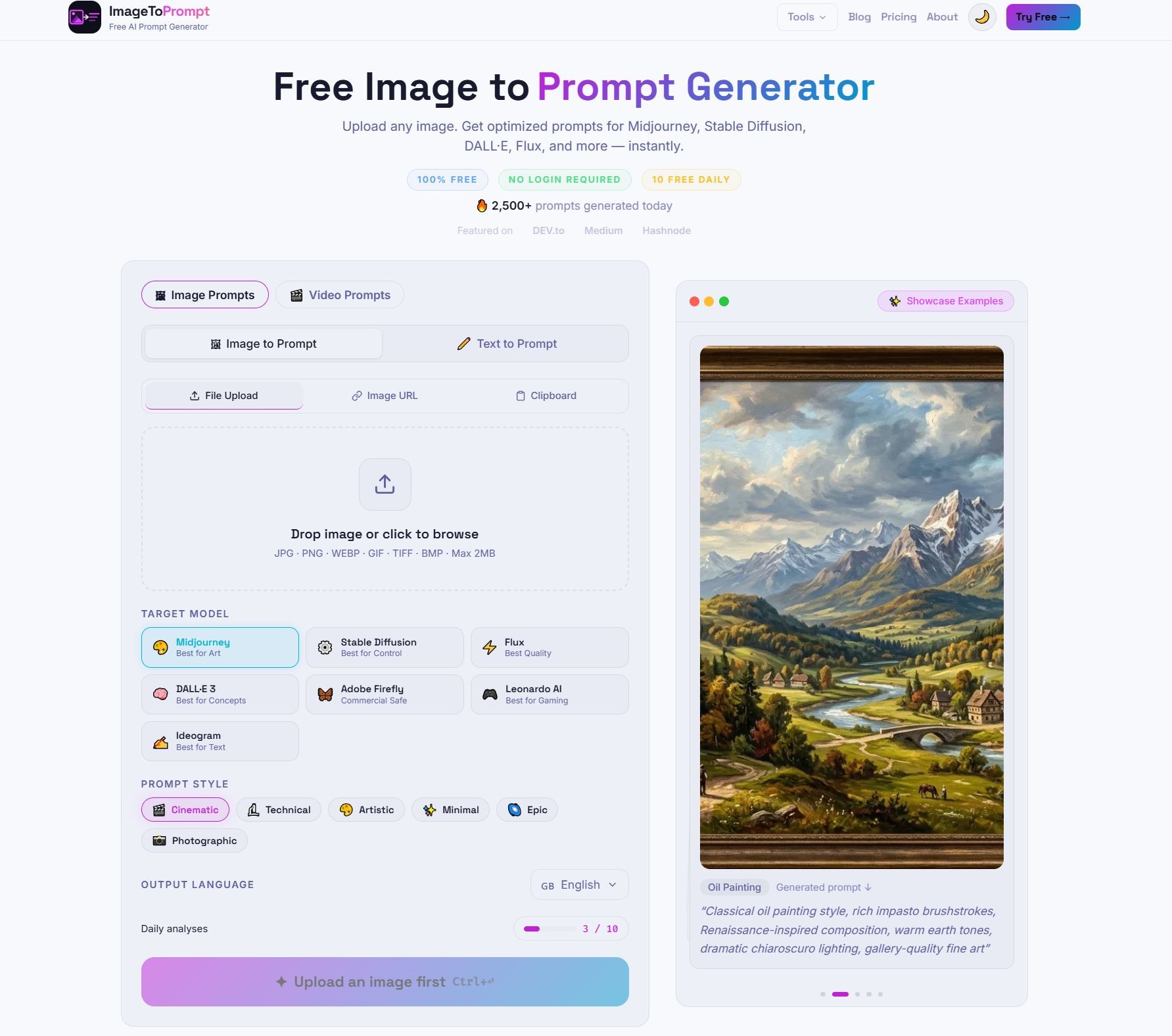

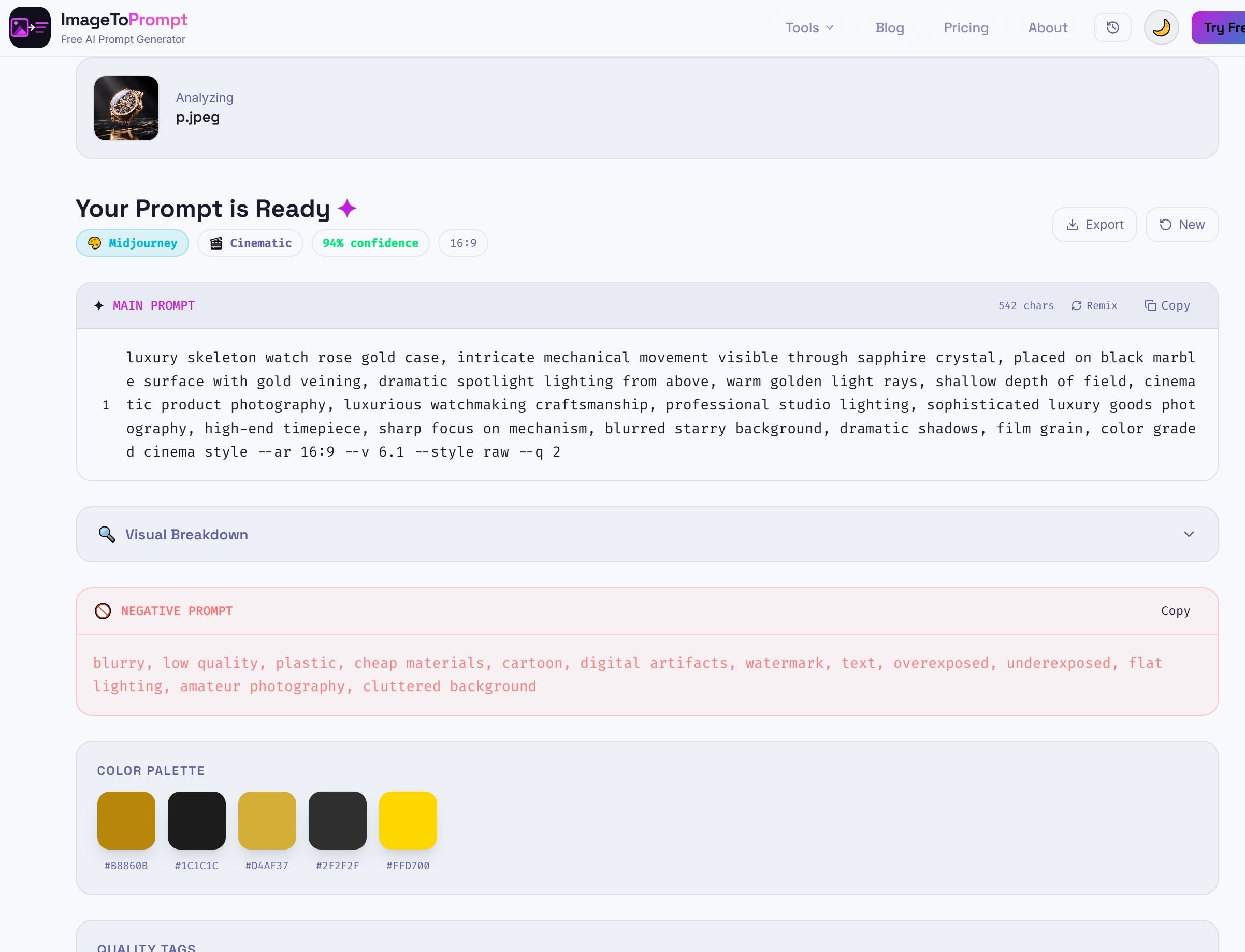

ImageToPromptのプロセスはシンプルです:

- 画像をアップロード — ドラッグ&ドロップ、クリックして参照、またはCtrl+Vで貼り付け

- ターゲットモデルを選択 — Midjourney、Stable Diffusion、Flux、DALL-E 3などから選択

- スタイルを選択 — シネマティック、テクニカル、アーティスティック、ミニマル、エピック、フォトグラフィック

- 生成をクリック — Claude AIが画像を分析し、プロンプトを生成します

分析には約5〜10秒かかり、以下が生成されます:

- 選択したモデル用にフォーマットされたメインプロンプト

- ネガティブプロンプト(Stable Diffusionモデル用)

- 画像を再解釈するクリエイティブリミックスバリエーション

- 抽出されたカラーパレット、スタイルタグ、品質タグ

- 推奨アスペクト比

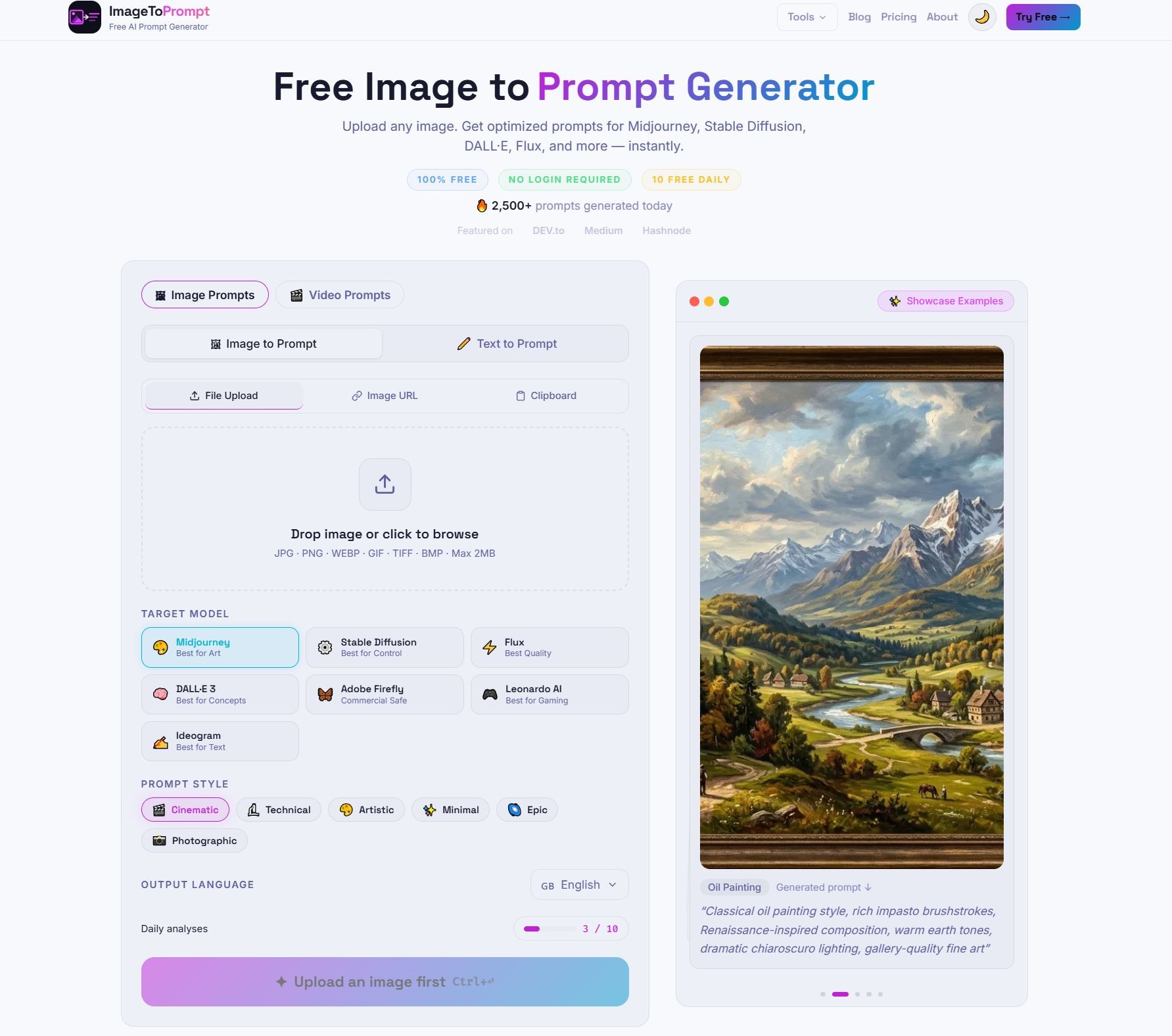

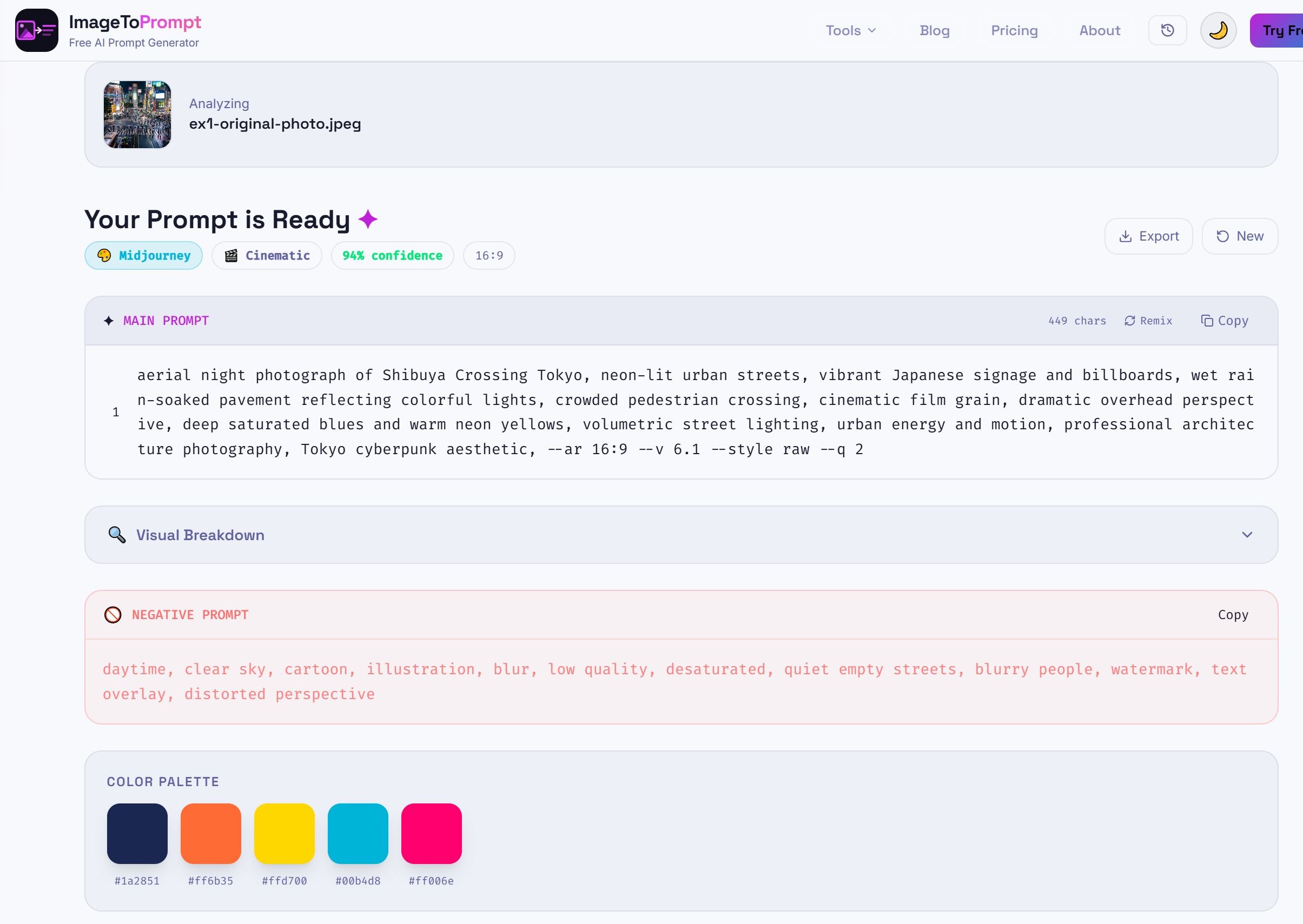

実例:変換の実際

写真からデジタルイラスト、AI生成画像まで、ImageToPromptがさまざまな種類の画像でどのように機能するかをご覧ください。

例1:写真 → プロンプト

ツールはゴールデンアワーの暖かいライティング、ワイドなランドスケープ構図、シネマティックな写真スタイルを検出しました。生成されたMidjourneyプロンプトには--ar 16:9とgolden hour lightingが含まれており、どちらも元の雰囲気を再現するために不可欠な要素です。

例2:デジタルイラスト → プロンプト

デジタルイラストの場合、AIはconcept art、digital paintingなどのスタイルキーワードと、特定のカラーパレットの記述子を特定することに優れています。これらのスタイルアンカーこそが、再現画像をオリジナルと一致させる鍵です。

例3:AIアート → プロンプト

AI生成画像には、元のモデル固有の微妙なスタイルシグネチャが含まれていることがあります。ImageToPromptはこれらを特定し、それを保持するプロンプトを生成します — 既存のAIアートを拡張またはバリエーションしたい場合に便利です。

ステップ4:生成されたプロンプトを改善する

AIが生成したプロンプトは優れた出発点ですが、最初から完璧であることはほとんどありません。以下の方法で改善できます:

具体性の追加または削除

結果が汎用的すぎる場合は、より具体的な詳細を追加してください。制約が強すぎる場合は、一部の記述子を削除してください。たとえば、「女性」は「巻き毛のオーバーンヘアの30代の女性」よりも曖昧です。

スタイルの重み調整

Stable Diffusionでは、最も重要なスタイル要素の重みを増やしましょう。Midjourneyでは、--style rawを追加してより忠実な解釈を得るか、--stylizeを上げてよりアーティスティックな効果を得ることができます。

リミックス機能で反復する

ImageToPromptはメインプロンプトと並行して「クリエイティブリミックス」プロンプトを生成します。これにより、予想外のクリエイティブな方向性を開く代替解釈が得られます。

ステップ5:テストと反復

プロンプトをターゲットAIジェネレーターに貼り付けて、3〜4つのバリエーションを生成しましょう。1回で止めないでください。ほとんどのAI画像生成ツールには固有のランダム性があり、同じプロンプトを複数回実行すると選択肢が広がります。

気に入った結果が見つかったら、何がうまくいき、何がうまくいかなかったかを記録してください。プロンプトの特定の要素を調整する際は、一度に1つの記述子だけを変更して、各視覚的変化に何が影響しているかを理解しましょう。

よくある5つの間違い

これらは常に期待はずれの結果を生む間違いです — そしてその回避方法です。

- 低解像度やぼやけたソース画像の使用。 AIは見えるものしか抽出できません。ぼやけた画像や圧縮された画像では情報が少なくなり、曖昧なプロンプトが生成されます。利用可能な最も鮮明で高解像度のソース画像を使用してください。

- モデルセレクターを無視する。 Midjourney用にフォーマットされたプロンプトはStable Diffusionではうまく機能せず、その逆も同様です。構文、重み付けシステム、パラメータインジケーターはすべて異なります。生成前に必ずターゲットモデルを選択してください。

- 出力をそのまま修正なしで使用する。 生成されたプロンプトは優れた出発点であり、完成品ではありません。批判的に読みましょう — すべての用語が望む結果に合っていますか?当てはまらない記述子を削除し、AIが見逃した要素を追加してください。

- 複数回生成してテストしない。 AI画像生成は確率的です。単一のプロンプトでも、シードのランダム性により優れた結果にも残念な結果にもなり得ます。プロンプトが機能しないと判断する前に、4〜8つのバリエーションを生成してください。

- 理解せずにプロンプトをコピーする。 プロンプトに含まれる用語の意味がわからなければ、結果が不十分なときに改善できません。各記述子が何をするのかを理解する時間を取りましょう — それは今後のすべての生成に役立ちます。

より良い結果を得るためのコツ

高品質なソース画像を使用する

AIはソース画像のあらゆる詳細を分析します。明確な構図を持つ高品質な画像は、より多くの情報を提供します。ソースがぼやけていたりコントラストが低い場合、生成されるプロンプトの精度は下がります。

複数のスタイルモードを試す

ImageToPromptのスタイルモード(シネマティック、テクニカル、アーティスティックなど)は、プロンプトの表現方法に影響します。シネマティックプロンプトはドラマと雰囲気を強調し、テクニカルプロンプトは精度とリアリズムを優先します。同じ画像でも各モードで異なる有用なプロンプトが生成されます。

カラーパレット出力を活用する

抽出されたカラーパレットは、画像の主要な色のヘックスコードを表示します。色の記述をサポートするプロンプトで直接参照できます:「落ち着いたティールと暖かいアンバーのカラーパレット」や「深いインディゴとローズゴールドが支配的なトーン」など。

コンテンツではなくスタイルを抽出する

画像→プロンプト変換の強力な使い方:画像を再現するのではなく、スタイルを抽出して別のものに適用します。参考画像からプロンプトを生成し、被写体を置き換えます。たとえば、ドラマチックな夕日の写真からライティングとムードを取り、「山の風景」を「都市のスカイライン」に置き換えます。

最初の画像を無料で変換

画像をアップロードするだけで、Midjourney、Stable Diffusion、Flux、DALL·E 3に最適化されたプロンプトが生成されます — 登録不要。

ImageToPromptを無料で試す →よくある質問

スクリーンショットやUIデザインも変換できますか?

はい、ただし結果はより抽象的になります。スクリーンショットやUIデザインは、写真の詳細よりもレイアウト、カラースキーム、ビジュアルスタイルに焦点を当てたプロンプトを生成する傾向があります。スタイルリファレンスの生成に役立ちます。

生成されたプロンプトで元の画像を正確に再現できますか?

いいえ — そしてそれは意図的です。AI画像生成は確率的です。完璧なプロンプトでも、コピーではなくオリジナルのバリエーションが生成されます。目標はビジュアルエッセンスをキャプチャすることであり、ピクセルの再現ではありません。

プロンプトが長すぎる場合はどうすればいいですか?

ほとんどのAIジェネレーターにはトークン制限があります。Stable Diffusionでは、75トークン(約60語)を超えるプロンプトはカットされる場合があります。最も重要な要素に焦点を当ててください。MidjourneyとFluxでは、より長いプロンプトが適切に処理されます。